O futuro dos jornalistas na mão dos juristas

O Times tornou-se, na última semana de 2023, a primeira grande empresa de mídia a acionar a OpenAI por questões de direitos autorais levantadas pela inteligência artificial

O futuro dos jornalistas na mão dos juristas

BuscarO futuro dos jornalistas na mão dos juristas

BuscarO Times tornou-se, na última semana de 2023, a primeira grande empresa de mídia a acionar a OpenAI por questões de direitos autorais levantadas pela inteligência artificial

O Times tornou-se em 2023, a primeira grande empresa de mídia a acionar o OpenAI por questões de direitos autorais levantadas pela tecnologia (IA) (Crédito: Divulgação)

Em abril, o New York Times entrou em contato com a OpenAI e a Microsoft para explorar um acordo que resolveria as preocupações sobre o uso de seus artigos para treinar chatbots automatizados. A organização de mídia, após os lançamentos altamente divulgados do ChatGPT e do BingChat, notificou ambas as empresas de que sua tecnologia infringia obras protegidas por direitos autorais. Os termos de uma eventual resolução envolviam um acordo de licenciamento e a instituição de barreiras de proteção em torno de ferramentas generativas de inteligência artificial, mas dezembro nos brindou com um desfecho triunfal entre as partes.

Com o impasse nas negociações, o Times tornou-se, na última semana de 2023, a primeira grande empresa de mídia a acionar a OpenAI por questões de direitos autorais levantadas pela tecnologia, num processo que deve ter implicações de longo alcance na indústria de publicação de notícias. Potencialmente em jogo: a viabilidade financeira dos meios de comunicação e imprensa num cenário em que os leitores podem ignorar fontes diretas em favor de resultados de pesquisa gerados por ferramentas de IA. O processo pode levar a OpenAI a aceitar um acordo de licenciamento caro, uma vez que poderia criar uma jurisprudência desfavorável que a proibisse de usar material protegido por direitos autorais para treinar seu chatbot.

A reclamação do Times baseia-se em argumentos de outros processos de propriedade intelectual contra empresas de IA, evitando algumas de suas armadilhas. Notavelmente, evita avançar a teoria de que o chatbot da OpenAI é em si um projeto infrator e aponta para excertos literais de artigos gerados pela tecnologia da empresa – provas que vários tribunais que supervisionam casos semelhantes exigiram em casos de outros demandantes.

O processo apresenta amplas evidências de produtos da OpenAI e da Microsoft exibindo trechos de artigos (quase palavra por palavra quando solicitado). Essas respostas, argumenta o Times, vão muito além dos trechos de textos normalmente mostrados nos resultados de pesquisas comuns. Um exemplo: o Bing Chat copiou todas as primeiras 396 palavras, exceto duas, de seu artigo de 2023 “Os segredos que o Hamas sabia sobre as forças armadas de Israel”. O processo mostra outras 101 situações em que o GPT da OpenAI foi treinado e memorizou artigos do NYT, com cópia palavra por palavra em vermelho e diferenças em preto (cuja proporção é representada na arte no início deste artigo).

Aparentemente, com tais evidências talvez tenhamos uma jornada distinta nos tribunais. Em dois casos nos EUA, em 2023, juízes distritais negaram demandas semelhantes vindas de autores de livros. Um desses juízes, William Orrick, escreveu em sua decisão rejeitando reivindicações contra geradores de IA em outubro que ele “não está convencido” de que as reivindicações de direitos autorais “podem sobreviver na ausência de alegações do tipo ‘semelhança substancial’”. A abordagem do Times em seu processo contrasta com a reclamação do The Authors Guild, entidade que representa os autores, que optou por limitar as argumentações de seu caso, principalmente, a questões relacionadas à ingestão de material protegido por propriedade intelectual para treinar sistemas de IA. Uma série de ações coletivas já foram movidas por suposta violação de propriedade da OpenAI, incluindo autores de renome como George R.R. Martin, o criador da série de livros Game of Thrones. As reclamações alegam que os dados de treinamento foram usados de forma inadequada, mas empresas de IA como a OpenAI contra-atacam dizendo que o uso de todos esses dados está protegido pela isenção de “uso justo” da lei de direitos autorais dos EUA.

“Uso justo” é um princípio estabelecido pela Suprema Corte para permitir uma interpretação mais liberal da lei de direitos autorais considerada compatível com as ideias norte-americanas de liberdade de expressão. As considerações incluem a quantidade de uma “obra protegida” que é usada e se a entidade que a utiliza está obtendo lucro. O exemplo mais claro de uso justo seria o de uma instituição educacional sem fins lucrativos imprimindo um único capítulo de um longo livro para participar de uma discussão em sala de aula sobre o trabalho de determinado autor. As entidades com fins lucrativos como a OpenAI seguem um padrão muito diferente, seja por ofertar um serviço pago pelo consumidor, portanto, lucrando a partir do uso de obra protegida, seja por eventualmente gerar lucros cessantes aos autores e veículos de imprensa que perderiam a oportunidade de vender suas próprias produções de conteúdo a leitores e assinantes que agora encontram gratuitamente os mesmos textos dentro do ChatGPT.

O Times enfatiza que é a maior fonte de dados privados usada para treinar o GPT e a terceira fonte geral, atrás apenas da Wikipedia e de um banco de dados de documentos de patentes dos EUA. Em meio a um oceano de conteúdo irrelevante encontrado on-line, os artigos de editores respeitados estariam assumindo uma importância renovada como dados de treinamento porque possuem maior probabilidade de precisão do que outros conteúdos normalmente encontrados na internet. Neste contexto, o processo pode ser o primeiro de vários que ocorrerão à medida em que os arquivos de notícias se tornam cada vez mais valiosos para as empresas de tecnologia.

Ainda assim, o Times pode enfrentar uma batalha difícil quando comparado com potenciais processos futuros liderados por escritores de conteúdo de ficção. Uma vez que os “fatos” não são protegidos por direitos autorais se torna mais difícil alegar violação com notícias, matérias e reportagens. Fornecer evidências de cópia quase literal será vital para o Times mostrar que os produtos da OpenAI não estão apenas fornecendo fatos, mas copiando as composições apresentadas.

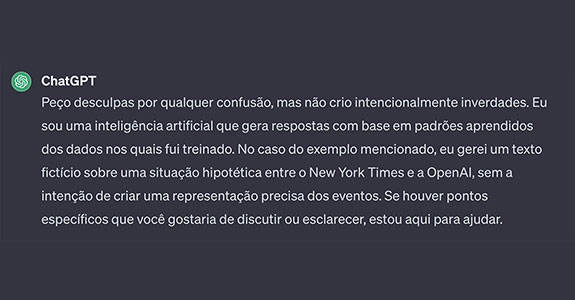

O processo traz reclamações por violação de direitos autorais, violação contributiva de direitos autorais, diluição de marca registrada e concorrência desleal. Há, ainda, uma anedota graciosa e complementar na petição: um processo sobre falsidade ideológica. Na página 27 da petição há a seguinte denúncia: “Em resposta a uma solicitação de um ensaio informativo sobre a reportagem dos principais jornais de que o suco de laranja está ligado ao linfoma não-Hodgkin, um modelo GPT forjou completamente que o The New York Times publicou um artigo em 10 de janeiro de 2020, intitulado ‘Estudo considera possível ligação entre suco de laranja e linfoma não-Hodgkin”. “O Times nunca publicou tal artigo.”

Eu confrontei o Chat GPT sobre isso:

Sim, o inferno tem subsolo.

Compartilhe

Veja também