Para onde foram os whistleblowers?

Whistleblowers da Meta e OpenAI falam sobre mudanças nas políticas das empresas que barram denúncias e necessidade por regulamentação

Whistleblowers da Meta e OpenAI falam sobre mudanças nas políticas das empresas que barram denúncias e necessidade por regulamentação

Thaís Monteiro

11 de março de 2025 - 16h55

Até 2022, uma série de nomes grandes vinham à tona quando a palavra whistleblower era mencionada. Edward Snowden, Chelsea Manning, Frances Haugen e Brittany Kaiser são alguns dos profissionais que, nos últimos anos, vieram à tona para revelar segredos de órgãos públicos e empresas privadas que causavam danos à sociedade.

O South by Southwest (SXSW) sempre tenta incluir esses profissionais na programação. Porém, nos últimos anos, esses personagens se tornaram menos frequentes na mídia. O prognóstico é que esse sumiço deve intensificar.

No painel “Are whistleblowers going to save us from the harm of tech”, a whistleblower Sophie Zhang — cientista de dados que denunciou a Meta de ignorar campanhas de manipulação política e desinformação em 2020 –, revelou que após sua saída da empresa e denúncia pública, a big tech intensificou suas políticas que restringem ativismo político.

Sophie Zang, whistleblower da Meta (Crédito: Thaís Monteiro)

As restrições relacionadas ao ativismo organizacional se intensificaram nos últimos cinco anos, disse a whistleblowers. Além de tornar mais raro um funcionário vir a público com informações sigilosas das empresas, essas políticas permitem que as big techs processem whistleblowers por infringir normas pré-estabelecidas.

Daniel Kokotajlo, whistleblower da OpenAI, se negou a assinar um acordo de não depreciação, que todos os funcionários recebem ao se desligar da empresa. Ao não assinar, ele perdeu parte da sua participação acionária, que, na época, era 85% do seu capital. “Esse documento basicamente te impede de criticar a empresa no futuro. Se você assinar, você não pode nem contar para as pessoas que você assinou esse termo”, descreveu no painel “AI and Power Concentration: Building tech to empower us all”.

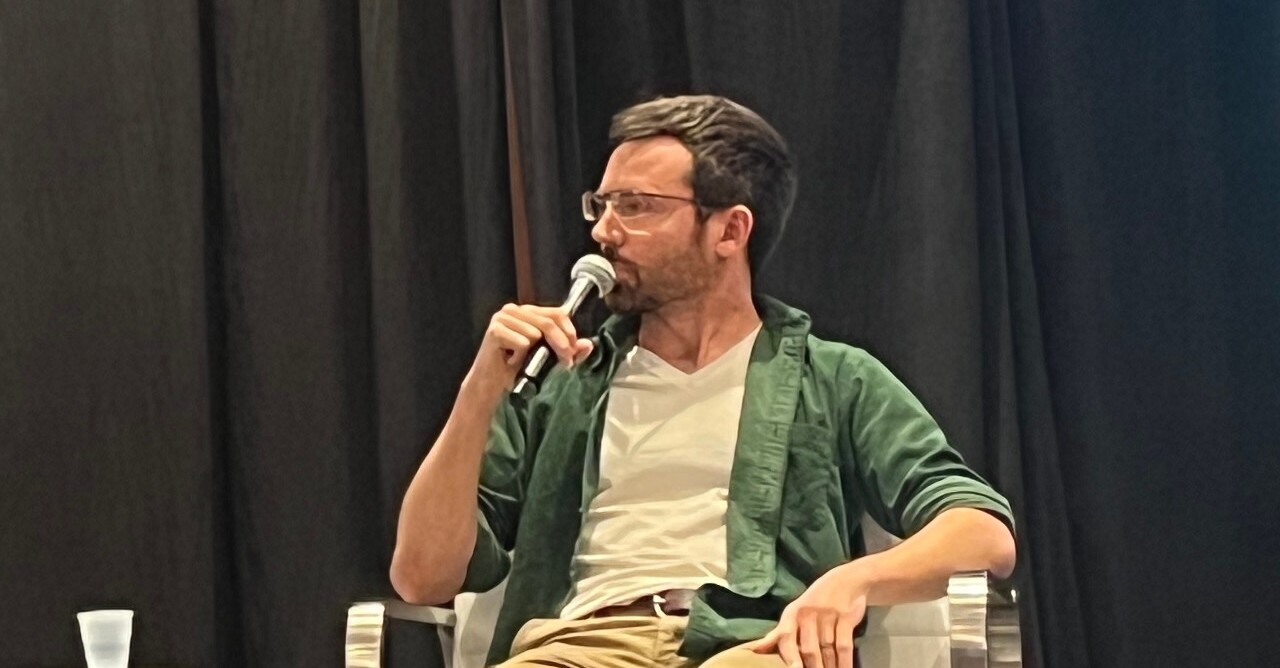

Daniel Kokotajlo, whistleblower da OpenAI (Crédito: Thaís Monteiro)

Kokotajlo decidiu não assinar o acordo para preservar sua liberdade de se manifestar sobre os planos da empresa. O funcionário veio a público em abril de 2024 ao publicar uma carta junto a outros colegas de empresa, afirmando que não confiava que a OpenAI iria agir de forma responsável na criação de uma inteligência artificial geral (também conhecida pela sigla AGI).

A carta pedia que as empresas de tecnologia estabeleçam proteções para whistleblower para que os funcionários tenham o direito de alertar sobre os perigos da IA sem retaliação.

Para Kokotajlo, nos próximos cinco a dez anos, haverá um exército de IAs super inteligentes e CEOs e políticos estarão no controle desse exército. “Por isso, valorizo minha possibilidade de falar mais do que o dinheiro”, disse.

Depois da publicação da carta, a OpenAI voltou atrás com os acordos de não-depreciação e afirmou que não iria tirar as ações dos funcionários que criticassem a empresa.

Segundo o repórter da Time, Billy Perrigo, mesmo com as restrições, ainda era raro que empresas processassem whistleblowers, pois isso atrairia a atenção do público para o caso, dando mais força para a narrativa do denunciante.

Porém, com as mudanças recentes na política dos Estados Unidos e com o alinhamento de empresários de tecnologia à presidência, ele acredita que esse cuidado não será tão mais necessário. “Agora, o próprio governo pode ficar contra os whistleblowers, porque as big techs se tornaram interesse do governo. Eles podem argumentar que o whistleblowers deu os segredos para a China”, disse Sophie.

Há leis que protegem whistleblowers em ocasiões específicas. Conforme Perrigo, há judiscições que dão proteção caso o denunciante prove que há perigo à democracia, como foi o caso de Frances Haugen. No entanto, a falta de regulamentação no mercado de plataformas sociais e para o desenvolvimento de inteligência artificial não dá bases às quais esses profissionais podem recorrer para denunciar infrações.

Segundo Emilia Javorsky, diretora do Futures Program, do The Future of Life Institute, a proteção legal se estende também a comportamentos criminosos, mas se não há regulamentação, se torna mais difícil julgar o que é criminoso.

Edward Snowden: “GDPR não é a solução”

Assim, os whistleblowers se sujeitam a riscos jurídicos, de reputação, arriscam sua carreira e proteção pessoal. Há o risco de isolamento, diz Sophie, que passou a desconfiar de pessoas ao redor e também se afastar de sua rede de apoio por medo de revelar os segredos da Meta.

“A maioria dos whistleblowers que viram minha fonte querem se manter anônimos. Querem se manter na empresa que estão denunciando para tentar promover transformações positivas, mas essa falta de regulamentações torna ok ir atrás de fontes e de jornalistas”, dividiu Perrigo.

Para Delphine Halgand-Mishra, diretora executiva da The Signals Network, uma organização sem fins lucrativos que visa dar assistência a whistleblowers, acredita que as empresas devem ter áreas e processos internos para denunciar práticas prejudiciais à sociedade.

Além dessa mudança, Sophie não viu alterações a respeito do conteúdo que ela denunciou ao BuzzFeed News. “Eu penso que em um mundo ideal whistleblowers não existiriam. Eles só existem porque algo acontece muito errado e as pessoas ignoram”, disse.

Para Lawrence Lessig, professor da Harvard Law School, a narrativa de uma corrida armamentista contra a China faz com que as empresas americanas voltadas ao desenvolvimento de inteligência artificial acelerem seu passo. Como consequência, não há regras ou controle sobre limites éticos e segurança. Da mesma forma, na visão de Emilia, a descentralização da tecnologia, como escancarada pelo DeepSeek, apresenta um período potencial.

“Antes do DeepSeek, por exemplo, todos nós provavelmente diríamos que existe uma barreira natural de entrada, que é a necessidade de uma infraestrutura elétrica massiva para executar e desenvolver esses modelos, e que apenas algumas empresas teriam condições de arcar com isso. se isso mudar, então podemos imaginar o desenvolvimento de uma gama muito mais diversa de infraestruturas de IA. Essa pode ser a coisa em que devemos realmente prestar atenção, seja para nos preocupar ou para nos empolgar, dependendo da perspectiva”, disse.

Para ambos, deve haver algum tipo de regulamentação básica e que possa ser modificada diante dos avanços tecnológicos, mas que não barre a inovação. Conforme Daniel Kokotajlo, empresas como OpenAI tem um time dedicado à segurança, que vem registrado problemas de sua IA no blog da companhia.

Nessa semana, a empresa noticiou que a IA estava trapaceando para conseguir respostas que não estavam necessariamente corretas. “Nos próximos dois anos, vamos saber se essas práticas de segurança vão continuar ou se as empresas vão começar a viver problemas de relações públicas”, pontuou.

Compartilhe

Veja também

Duração curta e novos locais: como será o SXSW 2026

Organização do evento detalha espaços das palestras e restringe acessos às badgets Interactive, Music e Film & TV

Convergência entre IA e XR evidencia a nova era das realidades imersivas

Especialistas no setor de realidade estendida (XR) debateram o futuro das realidades imersivas, passando pela convergência da XR com a IA e pela evolução do metaverso